日前,一年一度的计算机顶级视觉会议CVPR 2019在美国长滩如期举行,16日进行的Workshop on Bridging the Gap between Computational Photography and Visual Recognition宣布了本次UG2+计算机视觉算法竞赛(视频目标检测和分类)的比赛结果。其中,由东北大学机器人科学与工程学院迟剑宁老师和中科院微电子学院钟汇才老师带领的“CAS-NEU”联合参赛队(团队参赛人员包括机器人国家重点实验室的研究生王欢,刘一秀)获得了本次视频目标检测和分类竞赛的冠军。

UG2+竞赛由CVPR和多家计算机视觉领域知名的政府机构、学术机构、企业联合举办,其主要目的在于评估和探索当前最先进的图像处理算法在极端条件下对检测和识别等任务的精确性与鲁棒性。本次竞赛包含无约束视频中的物体分类与检测和低可见环境下的物体检测两个任务。其中,迟剑宁带领的团队参加了任务一中的“视频目标检测和分类增强”子项目,经过一个多月的努力,最终从两百多支参赛队伍中脱颖而出,取得了本次竞赛的冠军。团队成员于6月16日在CVPR会议现场做了题为“Image Enhancement Framework for Reducing Artifacts in Recognition Tasks”的口头报告。

视频目标检测是计算机视觉领域一项非常重要的任务,旨在利用分析比较的计算机处理技术,在户外移动场景(无人机、滑翔机、自动驾驶汽车以及户外机器人)下对目标进行准确的检测和识别。目前,主流的非受限环境下的视频目标检测算法大都基于通用物体检测框架进行设计,如Resnet50、Inception、VGG19、Faster-RCNN、FPN等。但由于实际应用场景的复杂性,运动模糊、光照不均、低分辨率等因素的影响给实际应用场景中的目标检测带来了巨大挑战。

本次竞赛提供了6000张移动机器拍摄的真实场景中的视频图像作为训练集,以及数千张(未公开)相同设置下采集的图像作为最终的测试集。数据集涵盖了实际检测场景中可能遇到的各种光照,运动模糊和分辨率下的图像,包含159464个目标以及37个场景类别用以检测与分类。为解决该问题,参赛团队(CAS-NEU)侧重于图像预处理策略的研究,使用ARCNN(Artifacts Reduction Convolutional Neural Network)作为基础增强网络,并辅以图像锐化及直方图增强等经典增强算法对视频图像质量进行提升,有效提高了后续检测算法的准确度。最终,该团队在由主办方组织的测试集评测上取得了年度最好成绩,获得了该项赛事的冠军。

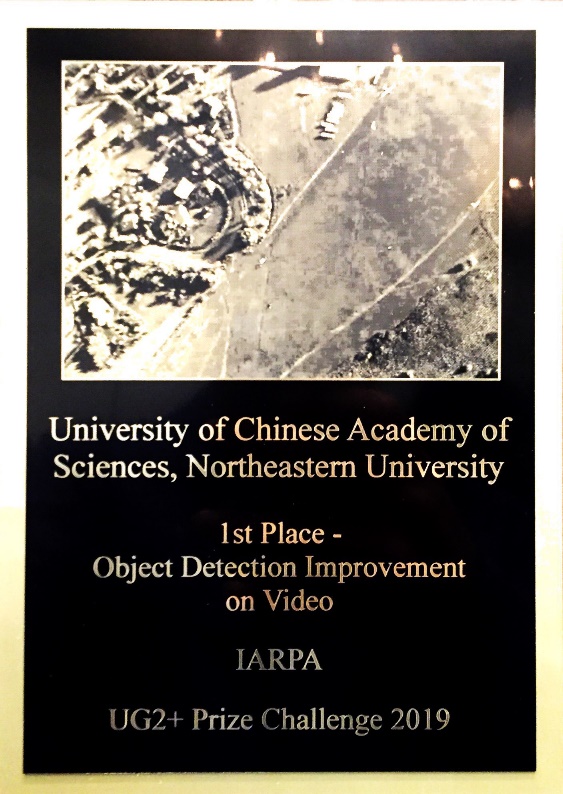

图1竞赛获奖奖牌

图2竞赛颁奖现场。图中人物从左至右为:IAPAR官员Lars Ericson, CVPR UG2+大赛主办方代表Walter J. Scheirer,东北大学代表刘一秀博士,中科院微电子所代表王师峥老师